Denominación de la asignatura |

La Búsqueda de Datos en el Periodismo de Investigación: Minería de Datos |

| Máster al que pertenece |

Master Universitario en Periodismo de Investigación, Datos y Visualización |

| Créditos ECTS |

6 |

| Cuatrimestre en el que se imparte |

Primer cuatrimestre |

| Carácter de la asignatura | Obligatoria |

Presentación

Esta asignatura pretende liberar al alumno de la dependencia de empresas o instituciones en cuanto al acceso y utilización de la información publicada sobre ellas. Independientemente del formato elegido por estas entidades para compartir sus datos, el alumno contará con herramientas para acceder a los datos y digitalizarlos o descargarlos de la manera más eficiente.

Con los sistemas de reconocimiento óptico de caracteres se eliminará la barrera relativa a la publicación de documentos en formato no reutilizable (PDF). Las herramientas de scraping, una vez conocida la arquitectura de la web, permitirán descargar grandes cantidades de información de manera estructurada. Asimismo, se probará el potencial de los datos generados en las redes sociales como fuente de información en el desempeño de la profesión, acompañando la muestra con herramientas que permiten hacer efectiva esta idea. Para todos estos casos, una vez conseguida la información, se mostrarán técnicas de limpieza que minimicen errores y maximicen precisión y eficiencia en el trabajo con los datos.

Por último, se hará una introducción al trabajo que otros perfiles más técnicos desarrollan en este mismo ámbito, dejando la puerta abierta a la profundización del alumno, o como mínimo, a la posibilidad de una colaboración fluida con programadores informáticos en el proceso de búsqueda de información.

Competencias

Competencias básicas

- CB6. Poseer y comprender conocimientos que aporten una base u oportunidad de ser originales en el desarrollo y/o aplicación de ideas, a menudo en un contexto de investigación.

- CB7. Que los estudiantes sepan aplicar los conocimientos adquiridos y su capacidad de resolución de problemas en entornos nuevos o poco conocidos dentro de contextos más amplios (o multidisciplinares) relacionados con su área de estudio.

- CB8. Que los estudiantes sean capaces de integrar conocimientos y enfrentarse a la complejidad de formular juicios a partir de una información que, siendo incompleta o limitada, incluya reflexiones sobre las responsabilidades sociales y éticas vinculadas a la aplicación de sus conocimientos y juicios.

- CB9. Que los estudiantes sepan comunicar sus conclusiones y los conocimientos y razones últimas que las sustentan a públicos especializados y no especializados de un modo claro y sin ambigüedades.

- CB10. Que los estudiantes posean las habilidades de aprendizaje que les permitan continuar estudiando de un modo que habrá de ser en gran medida autodirigido o autónomo.

Competencias generales

- CG1. Aplicar los conocimientos adquiridos para resolver problemas en diferentes entornos dentro de contextos multidisciplinares relacionados con el periodismo de investigación basado en datos.

- CG3. Integrar los conocimientos adquiridos y utilizar la terminología adecuada en relación al periodismo de investigación basado en datos.

- CG4. Actualizar la información y los conocimientos de forma autónoma, para estar al día de las últimas tendencias en el periodismo de investigación basado en datos y su visualización.

Competencias específicas

- CE1. Seleccionar los datos más relevantes para la investigación en curso dentro de una amplia gama de fuentes de datos adaptadas al periodismo de investigación basado en datos y su visualización.

- CE2. Analizar y resumir los datos desde una perspectiva científica para su aplicación y uso en el periodismo de investigación.

- CE3. Explorar y detectar anomalías en los datos obtenidos de diversas fuentes para su utilización en el periodismo de investigación.

- CE4. Familiarizarse con diversos estándares de datos y utilizar herramientas de conversión entre ellos en el contexto del periodismo de investigación basado en datos y su visualización.

Competencias transversales .

- CT2. Identificar las nuevas tecnologías como herramientas didácticas para el intercambio comunicacional en el desarrollo de procesos de indagación y de aprendizaje grupal.

- CT3. Aplicar los conocimientos y capacidades aportados por los estudios a casos reales y en un entorno de grupos de trabajo en empresas u organizaciones.

- CT4. Adquirir la capacidad de trabajo independiente, impulsando la organización y favoreciendo el aprendizaje autónomo.

Contenidos

Tema 1. Introducción a la Minería de Datos

Introducción a la Minería de datos

Minería y Big Data

Configuración de los datos.

Técnicas de minería de datos

Minería y medios

Tema 2. El «ecosistema» de los datos

Cómo encontrarlos

Formatos: xls, csv, json, pdf, kml, shp…

Algunos conversores

Calidad de los datos

Tema 3. Extracción de datos de PDF

¿Por qué es necesario?

Consideraciones previas

Tabula y otros OCR de texto

OCR de imagen

Evaluación del resultado.

Tema 4. Exprimir la web

Investigar online

Búsqueda avanzada en Google

Investigación basada en «metadatos»

Información sobre webs y dominios

Búsqueda inversa de imágenes

Tema 5. Las redes sociales como fuente de datos (e historias)

5.1. ¿Cómo estudiar este tema?

5.2. La utilidad de las redes sociales

5.3. Exprimir las redes

5.4. Twitter y Carto

Tema 6. Técnicas de recopilación de datos en la web I

6.1. ¿Cómo estudiar este tema?

6.2. ¿Por qué es necesario?

6.3. Introducción a HTML y CSS

6.4. Importar con Google

6.5. Introducción a XPATH

6.6. Scraper

Tema 7. Técnicas de recopilación de datos en la web II

7.1. ¿Cómo estudiar este tema?

7.2. Import.io

7.3. ParseHub

7.4. ¿Cuándo recurrir al webscraping?

Tema 8. Limpieza y transformación de los datos

8.1. ¿Cómo estudiar este tema?

8.2. ¿Por qué son necesarias?

8.3. ¿Dónde están los problemas?

8.4. Maniobras básicas sin salir de Excel

8.5. Add-ins para limpiar datos en Excel

Tema 9. Limpieza y transformación de los datos en OpenRefine

9.1. ¿Cómo estudiar este tema?

9.2. Breve historia

9.3. Instalación y puesta en marcha

9.4. Anatomía y funciones de OpenRefine

9.5. Geolocalización con OpenRefine

Tema 10. Lenguajes de programación y API en Minería

¿Para qué programar?

Los lenguajes

Conceptos generales de programación

Introducción a Python

API

Un ejemplo: The Juicer

Referencias bibliográficas

Metodología

Las actividades formativas de la asignatura se han elaborado con el objetivo de adaptar el proceso de aprendizaje a las diferentes capacidades, necesidades e intereses de los alumnos.

Las actividades formativas de esta asignatura son las siguientes:

- Trabajos. Se trata de actividades de diferentes tipos: reflexión, análisis de casos, prácticas, etc.

- Participación en eventos. Son eventos programados todas las semanas del cuatrimestre: sesiones presenciales virtuales, foros de debate, test.

En la programación semanal puedes consultar cuáles son las actividades concretas que tienes que realizar en esta asignatura.

Estas actividades formativas prácticas se completan, por supuesto, con estas otras:

- Estudio personal

- Tutorías. Las tutorías se pueden articular a través de diversas herramientas y medios. Durante el desarrollo de la asignatura, el profesor programa tutorías en días concretos para la resolución de dudas de índole estrictamente académico a través de las denominadas “sesiones de consultas”. Como complemento de estas sesiones se dispone también del foro “Pregúntale al profesor de la asignatura” a través del cual se articulan algunas preguntas de alumnos y las correspondientes respuestas en el que se tratan aspectos generales de la asignatura. Por la propia naturaleza de los medios de comunicación empleados, no existen horarios a los que deba ajustarse el alumno.

- Examen final presencial

Las horas de dedicación a cada actividad se detallan en la siguiente tabla:

ACTIVIDADES FORMATIVAS |

HORAS |

| Sesiones Presenciales Virtuales | 15,0 |

| Lecciones magistrales | 6,0 |

| Talleres prácticos virtuales | 12,5 |

| Estudio del material básico | 44,5 |

| Lectura de material complementario | 18,0 |

| Trabajos, casos prácticos, test | 29,0 |

| Tutorías | 16,0 |

| Trabajo colaborativo | 7,0 |

| Examen final presencial | 2 |

Total |

150 |

Bibliografía

Bibliografía básica

La asignatura se estudia a través de los apuntes elaborados por UNIR y que están desarrollados a través de las Ideas clave.

Bibliografía complementaria

Armendáriz, Agustín; Taggart, Kendall (2015). Useful command line tools for reporters

URL: https://github.com/armendariz/terminal_recipes

BBC. The Juicer. Disponible en web: http://bbcnewslabs.co.uk/projects/juicer/

Beggin, R. (2016). How journalists can apply ethical frameworks to webscraping. Disponible en web: http://ire.org/blog/car-conference-blog/2016/03/11/how-journalists-can-apply-ethical-frameworks-web-s/

Bradshaw, P. (2012). Scraping for Journalists. Disponible en la web: http://acervo-digital.espm.br/e-books/scrapingforjournalists.pdf

CartoDB. Connecting Twitter Data to a CartoDB Dataset

URL: https://docs.cartodb.com/tutorials/connect_twitter_datasource/#twitter-credits

Crucianelli, S. (2014). Herramientas digitales para periodistas. Disponible en web: https://knightcenter.utexas.edu/hdpp.pdf

Geere, Duncan (2012). Engaging people around your data.

Disponible en web: http://datajournalismhandbook.org/1.0/en/delivering_data_10.html

Google (2014). Tutorial de KML. Disponible en web:https://developers.google.com/kml/documentation/kml_tut?hl=es

Graves, Lucas; Nyhan, Brendan (2015). Why do Journalists Fact-check?

URL: http://ejc.net/magazine/article/minority-voices-on-social-media-networks

Harvey, P. (2016). Installing Exiftool. Disponible en web: http://www.sno.phy.queensu.ca/~phil/exiftool/install.html

Hirst, Tony (2013). Analysing UK Lobbying Data Using OpenRefine

Disponible en web: http://schoolofdata.org/2013/06/04/analysing-uk-lobbying-data-using-openrefine/

Import.io. Manual XPATHs. Disponible en la web:http://importio.desk.com/customer/en/portal/articles/2399490-manual-xpaths?b_id=12993

JSON.org. Introducción a JSON. Disponible en web:http://www.JSON.org/JSON-es.html

Lai, R. (2014). Free the Data. Disponible en web: http://ire.org/blog/car-conference-blog/2014/03/01/free-data-getting-government-agencies-give-goods/

Léchenet, A. (2014). The Role of the Computer Assisted Reporter. Disponible en web:https://reutersinstitute.politics.ox.ac.uk/sites/default/files/Global%20Database%20Investigations%20-%20The%20role%20of%20the%20computer-assisted%20reporter.pdf

M. Russel, D. (2015). Learning Rapidly. Disponible en web:http://searchresearch1.blogspot.com.es/2015/05/answer-conversation-about-learning.html

Mazzote, N. (2013). 5 herramientas digitales para extraer datos de archivos PDF.Disponible en web: https://knightcenter.utexas.edu/es/blog/00-13777-5-herramientas-digitales-para-extraer-datos-de-archivos-pdf-protegidos

McGoveran, Catherine (2014). import.io + OpenRefine + Google Fusion Tables = Magic!

Disponible en web: https://www.import.io/post/importio-open-refine-google-fusion-tables-magic/

Metodología de Offshore Leaks. Disponible en web: https://www.icij.org/offshore/how-icijs-project-team-analyzed-offshore-files

Nguyen, D. (2010). Scraping for Journalism: A Guide for Collecting Data. Disponible en web: https://www.propublica.org/nerds/item/doc-dollars-guides-collecting-the-data

Nguyen, D. (2010). A guide for collecting data. Disponible en la web: https://www.propublica.org/nerds/item/doc-dollars-guides-collecting-the-data

Nguyen, Dan (2010). Using Google Refine to Clean Messy Data. Disponible en web: https://www.propublica.org/nerds/item/using-google-refine-for-data-cleaning

OpenDataSoft. Open Data Portals arround the World. Disponible en web: https://www.opendatasoft.com/a-comprehensive-list-of-all-open-data-portals-around-the-%20world/

Orenstein, D. (2000) Application Programming Interface. Disponible en web: http://www.computerworld.com/article/2593623/app-development/application-programming-interface.html

Paul Myers (2016). How to Save Online Evidence and Why it Matters. Disponible en web: http://www.bbc.co.uk/blogs/collegeofjournalism/entries/d94c04e8-a12a-47a5-8943-b3bc4db4e313

Quartz (2015). Quartz Guide to Bad Data. Disponible en la web: https://github.com/Quartz/bad-data-guide

Rankovic, Larisa (2011). Minority voices on social media networks

Disponible en web: http://ejc.net/magazine/article/minority-voices-on-social-media-networks

Richardson, Leonard (2015). Beautiful Soup. Disponible en web: https://www.propublica.org/nerds/item/the-stories-of-everyday-lives-hidden-in-reams-of-data

Rivas Santos, V.M. (2001). Tutorial de XPATH. Disponible en web: http://geneura.ugr.es/~victor/cursillos/xml/XPath/

School of Data (2014). Evita errores al momento de limpiar tus datos. Disponible en web: http://es.schoolofdata.org/2014/02/03/evita-errores-al-momento-de-limpiar-tus-datos/

Shiab, N. (2015). On the Ethics of Web Scraping. Disponible en la web: http://gijn.org/2015/08/12/on-the-ethics-of-web-scraping-and-data-journalism/

Silverman, Craig; Tsubaki, Rina (2014). A guide to Verifying Digital Conten in Emergencies. Disponible en web: http://gijn.org/2014/03/18/a-guide-to-verifying-digital-content-for-emergency-coverage/

Sweigart, Al (2015). APIs, not apps: What the future will be like when everyone can code. Disponible en web: https://opensource.com/education/15/9/apis-not-apps

W3Schools. XML tutorial. Disponible en web:http://www.w3schools.com/xml/

Wentworth, Peter; Elkner, Jeffrey; Downey, Allen B.; Meyers, Chris (2012). How to think like a Computer Scientist.

Disponible en web: http://openbookproject.net/thinkcs/python/english3e/

W3Schools. HTML 5 Tutorial. Disponible en web: http://www.w3schools.com/html/default.asp

Evaluación y calificación

El sistema de calificación se basa en la siguiente escala numérica:

0 - 4, 9 |

Suspenso |

(SS) |

5,0 - 6,9 |

Aprobado |

(AP) |

7,0 - 8,9 |

Notable |

(NT) |

9,0 - 10 |

Sobresaliente |

(SB) |

La calificación se compone de dos partes principales:

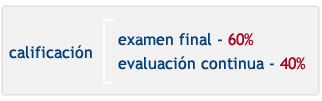

El examen se realiza al final del cuatrimestre y es de carácter PRESENCIAL y OBLIGATORIO. Supone el 60% de la calificación final y para que la nota obtenida en este examen se sume a la nota final, es obligatorio APROBARLO.

La evaluación continua supone el 40% de la calificación final. Este 40% de la nota final se compone de las calificaciones obtenidas en las diferentes actividades formativas llevadas a cabo durante el cuatrimestre.

Ten en cuenta que la suma de las puntuaciones de las actividades de la evaluación continua permite que realices las que prefieras hasta conseguir el máximo puntuable mencionado. En la programación semanal de la asignatura, se detalla la calificación máxima de cada actividad o evento concreto puntuables.

SISTEMA DE EVALUACIÓN |

PONDERACIÓN |

PONDERACIÓN |

Participación del estudiante |

8,3% |

8,3% |

Trabajos y casos prácticos |

30% |

30% |

Test de autoevaluación |

1,7% |

1,7% |

TOTAL EVALUACIÓN CONTINUA |

40% |

40% |

Examen final presencial |

60% |

60% |

TOTAL EVALUACIÓN FINAL |

60% |

60% |

Si quieres presentarte solo al examen final, tendrás que obtener una calificación de 5 puntos sobre 6 para aprobar la asignatura.

Profesorado

Montse Hidalgo

Formación

Licenciada en Periodismo y diplomada en Comunicación Política por la Universidad de Navarra y Máster en Periodismo de Investigación, Datos y Visualización por la Universidad Rey Juan Carlos y Unidad Editorial.

Experiencia

Actualmente es periodista freelance en diferentes medios de comunicación. Antes ha trabajado como redactora en El Mundo Data, El Diario Vasco y La Opinión de Tenerife.

Orientaciones para el estudio

Obviamente, al tratarse de formación online puedes organizar tu tiempo de estudio como desees, siempre y cuando vayas cumpliendo las fechas de entrega de actividades, trabajos y exámenes. Nosotros, para ayudarte, te proponemos los siguientes pasos:

- Desde el Campus virtual podrás acceder al aula virtual de cada asignatura en la que estés matriculado y, además, al aula virtual del Curso de introducción al campus virtual. Aquí podrás consultar la documentación disponible sobre cómo se utilizan las herramientas del aula virtual y sobre cómo se organiza una asignatura en la UNIR y también podrás organizar tu plan de trabajo personal con tu profesor-tutor.

- Observa la programación semanal. Allí te indicamos qué parte del temario debes trabajar cada semana.

- Ya sabes qué trabajo tienes que hacer durante la semana. Accede ahora a la sección Temas del aula virtual. Allí encontrarás el material teórico y práctico del tema correspondiente a esa semana.

- Comienza con la lectura de las Ideas clave del tema. Este resumen te ayudará a hacerte una idea del contenido más importante del tema y de cuáles son los aspectos fundamentales en los que te tendrás que fijar al estudiar el material básico. Lee siempre el primer apartado, ¿Cómo estudiar este tema?, porque allí te especificamos qué material tienes que estudiar. Consulta, además, las secciones del tema que contienen material complementario (Lo + recomendado y + Información).

- Dedica tiempo al trabajo práctico (sección Actividades y Test). En la programación semanal te detallamos cuáles son las actividades correspondientes a cada semana y qué calificación máxima puedes obtener con cada una de ellas.

- Te recomendamos que participes en los eventos del curso (sesiones presenciales virtuales, foros de debate…). Para conocer la fecha concreta de celebración de los eventos debes consultar las herramientas de comunicación del aula vitual. Tu profesor y tu profesor-tutor te informarán de las novedades de la asignatura.

Recuerda que en el aula virtual del Curso de introducción al campus virtual puedes consultar el funcionamiento de las distintas herramientas del aula virtual: Correo, Foro, Sesiones presenciales virtuales, Envío de actividades, etc.

|

Ten en cuenta estos consejos…

|