Denominación de la asignatura |

Ingeniería para el Procesado Masivo de Datos |

| Postgrado al que pertenece |

Máster universitario en Análisis y Visualización de Datos Masivos / Visual Analytics & Big Data |

| Créditos ECTS |

6 |

| Curso y cuatrimestre en el que se imparte |

Primer cuatrimestre |

| Carácter de la asignatura | Obligatoria |

Presentación

La idoneidad de las técnicas de inteligencia artificial en diferentes tipos de problemas hace que exista una gran cantidad de herramientas software que permiten su rápida aplicación, adaptación a un problema concreto. En esta asignatura nos centraremos en el lenguaje R.

Además, en esta asignatura se presentará el framework Hadoop, que proporciona sistemas y técnicas para el almacenamiento y el procesamiento distribuido de grandes cantidades de datos. En particular, la asignatura busca familiarizar al estudiante con HDFS (Hadoop Distributed File System), el sistema de archivos que utiliza Hadoop para el almacenamiento de datos, y con MapReduce, el paradigma de programación ideado por Google en 2004 y empleado por Hadoop para el procesamiento de datos de forma paralela. Del mismo modo, se presentarán al estudiante otras utilidades integradas dentro del ecosistema Hadoop, tales como Hive (lenguaje similar a SQL para realizar consultas de datos) o Pig (lenguaje de script para realizar análisis de datos de forma sencilla), que pueden resultar un recurso útil y eficiente para la realización de ciertas tareas. También se introducirán técnicas para conectar Hadoop con otras tecnologías como R, con el fin de aumentar las posibilidades que permite. Finalmente se estudiarán algunos casos de uso en los que se ha empleado Hadoop, tanto en la industria como en el entorno científico, con el fin de que se puedan comprender mejor los problemas que se pueden resolver con las herramientas aprendidas durante el curso.

Competencias

Competencias básicas

- CB6. Poseer y comprender conocimientos que aporten una base u oportunidad de ser originales en el desarrollo y/o aplicación de ideas, a menudo en un contexto de investigación.

- CB7. Que los estudiantes sepan aplicar los conocimientos adquiridos y su capacidad de resolución de problemas en entornos nuevos o poco conocidos dentro de contextos más amplios (o multidisciplinares) relacionados con su área de estudio.

- CB8. Que los estudiantes sean capaces de integrar conocimientos y enfrentarse a la complejidad de formular juicios a partir de una información que, siendo incompleta o limitada, incluya reflexiones sobre las responsabilidades sociales y éticas vinculadas a la aplicación de sus conocimientos y juicios.

- CB9. Que los estudiantes sepan comunicar sus conclusiones, y los conocimientos y razones últimas que las sustentan, a públicos especializados y no especializados de un modo claro y sin ambigüedades.

- CB10. Que los estudiantes posean las habilidades de aprendizaje que les permitan continuar estudiando de un modo que habrá de ser en gran medida autodirigido o autónomo.

Competencias generales

- CG1. Diseñar y elaborar planes de intervención profesional relacionados con el entorno de análisis de datos y visualización de la información, e implementarlos y desarrollarlos mediante los métodos y procesos adecuados.

- CG2. Tener la capacidad necesaria para ejercer las funciones profesionales requeridas para el análisis de datos y la visualización de la información en el seno de las entidades de TI.

- CG3. Evaluar los recursos necesarios, planificar y organizar las actividades, sin olvidar la revisión del propio progreso y desempeño en el análisis de datos y visualización de la información.

Competencias específicas

- CE6. Explicar las características de una situación física o virtual a partir del conjunto de datos que la define y construir diagramas que representen de forma visual dicha situación.

- CE7. Evaluar y asesorar sobre las técnicas de inteligencia artificial aplicables para el procesado masivo de datos sobre un conjunto dado de datos y de acuerdo a unos requisitos establecidos.

- CE8. Diseñar e implementar una estrategia integrada de técnicas estadísticas y de inteligencia artificial para el desarrollo de sistemas descriptivos y predictivos.

- CE9. Comprender el funcionamiento y características de las técnicas habituales de procesamiento masivo de datos.

- CE10. Anticipar los riesgos y beneficios derivados de la aplicación de las técnicas de procesamiento masivo de datos en una situación real.

- CE11. Identificar las herramientas comerciales y de software libre orientadas al análisis estadístico, inteligencia artificial y procesamiento masivo de datos.

Competencias transversales

- CT2. Identificar las nuevas tecnologías como herramientas didácticas para el intercambio comunicacional en el desarrollo de procesos de indagación y de aprendizaje.

- CT4. Adquirir la capacidad de trabajo independiente, impulsando la organización y favoreciendo el aprendizaje autónomo.

Contenidos

Tema 1. Introducción a Hadoop

¿Qué es Hadoop?

Principales distribuciones de Hadoop

Desplegando Hadoop

Referencias bibliográficas

Tema 2. HDFS: Almacenando grandes cantidades de datos

Introducción a HDFS

Almacenando datos en HDFS

¿Qué hay detrás de HDFS?

Referencias bibliográficas

Tema 3. MapReduce: Procesando grandes cantidades de datos

Introducción a MapReduce

Mi primer MapReduce

¿Qué hay detrás de MapReduce?

Hive: para amantes del SQL

Pig: para amantes del scripting

Mahout: machine learning con Hadoop

Conectando Hadoop con R

Referencias bibliográficas

Tema 4. Un nuevo enfoque al procesamiento de datos: Apache Spark

Spark: un ecosistema completo

Transformaciones y acciones con Spark

Introducción a Spark Streaming y Spark SQL

Introducción a Spark Streaming y Spark SQL

Aprendizaje automático con Spark MLlib

Referencias bibliográficas

Tema 5. Hadoop en el mundo real

Aplicaciones en la industria

Aplicaciones en la academia

Cuándo no usar clúster Big Data

Referencias bibliográficas

Tema 6. Introducción a R

¿Qué es R?

Orígenes y antecedentes

¿Por qué R?

Instalación del entorno de R

Primeros pasos con R

Consejos prácticos sobre el uso de la consola de R

Tema 7. El lenguaje R

Características básicas del lenguaje R

Tipos de datos y operadores

Estructuras de datos

Estructuras de control

Funciones

Tema 8. Introducción al análisis de datos con R (I)

Manipulación de datos

Estadística básica con R

Introducción a la minería de datos con R

Tema 9. Introducción al análisis de datos con R (II)

Minería de texto

Análisis de grafos

Tema 10. Gráficos y visualización de datos

Creando gráficos básicos con R

Personalización de gráficos

Combinando gráficos

Exportando gráficos a fichero

Interacción básica con gráficos

Metodología

Las actividades formativas de la asignatura se han elaborado con el objetivo de adaptar el proceso de aprendizaje a las diferentes capacidades, necesidades e intereses de los alumnos.

Las actividades formativas de esta asignatura son las siguientes:

- Trabajos: Actividades de cierta complejidad que conllevan por ejemplo una búsqueda de información, análisis y crítica de lecturas, resolución de problemas, etc.

- Casos prácticos: El objetivo pedagógico es que el estudiante detecte situaciones relevantes, analice la información complementaria, tome decisiones en relación con el escenario que se plantea y proponga soluciones o indique cómo mejorar la situación de partida.

- Laboratorios virtuales: Son sesiones presenciales virtuales que se llevan a cabo con herramientas de videoconferencia cuyo objetivo es que los alumnos utilicen algún tipo de herramienta informática para realizar uno o varios supuestos prácticos.

- Test de autoevaluación: Al final de cada tema, los estudiantes pueden realizar este tipo de test, que permite al profesor valorar el interés del estudiante en la asignatura.

En la programación semanal puedes consultar cuáles son las actividades concretas que tienes que realizar en esta asignatura.

Estas actividades formativas prácticas se completan, por supuesto, con estas otras:

- Estudio personal

- Tutorías. Las tutorías se pueden articular a través de diversas herramientas y medios. Durante el desarrollo de la asignatura, el profesor programa tutorías en días concretos para la resolución de dudas de índole estrictamente académico a través de las denominadas “sesiones de consultas”. Como complemento de estas sesiones se dispone también del foro “Pregúntale al profesor de la asignatura” a través del cual se articulan algunas preguntas de alumnos y las correspondientes respuestas en el que se tratan aspectos generales de la asignatura. Por la propia naturaleza de los medios de comunicación empleados, no existen horarios a los que deba ajustarse el alumno.

- Examen final presencial

Las horas de dedicación a cada actividad se detallan en la siguiente tabla:

ACTIVIDADES FORMATIVAS |

HORAS |

| Sesiones Presenciales Virtuales | 15,0 |

| Lecciones magistrales | 6,0 |

| Estudio Personal de material básico | 50,0 |

| Lectura de material complementario | 25,0 |

| Casos prácticos y laboratorios virtuales | 15,0 |

| Trabajos y test de evaluación | 14,0 |

| Tutorías | 16,0 |

| Trabajo colaborativo, foro, chat, debates | 7,0 |

| Evaluación final presencial | 2,0 |

Total |

150 |

Bibliografía

Bibliografía básica

Los textos necesarios para el estudio de la asignatura han sido elaborados por la UNIR y están disponibles en formato digital para consulta, descarga e impresión en el aula virtual.

Bibliografía complementaria

Bianchi, V., Dasgupta, N. y Anjoleto, R. (2018). Hands-On Data Science with R. Reino Unido: Packt Publishing.

Dean, J. y Ghemawat, S. (2004). MapReduce: Simplified Data Processing on Large Clusters. In Proceedings of the 6th Symposium on Operating System Design and Implementation.

Grolemund, G. y Wickham, H. (2016). R for Data Science. Estados Unidos: O'Reilly Media.

Kabacoff, R. (2011). R in action. Nueva York: Editorial Manning.

Loebman, S., Nunley, D., Yong-Chul, K., Howe, B., Balazinska, M. y Gardner, J. P. (2009). Analyzing massice astrophysical datasets: Can Pig/Hadoop or a relational DBMS help? Proceedings of the 2009 IEEE International Conference on Cluster Computing and Workshops, 1-10.

Singh, C. y Kumar, M. (2019). Mastering Hadoop 3. Reino Unido: Packt Publishing.

Taylor, R. (2010). An overview of the Hadoop/MapReduce/HBase framework and its current applications on bioinformatics. BMC Bioinformatics, 11.

White, T. (2012). Hadoop. The Definitive Guide (3rd Edition). Massachusetts: O’Reilly.

White, T. (2015). Hadoop The Definitive Guide 4th Edition. Storage and Analysis at Internet Scale. Estados Unidos: O'Reilly Media.

Zaharia, M. y Chambers, B. (2018). Spark: The Definitive Guide. Big Data Processing Made Simple. Estados Unidos: O'Reilly Media Release.

Evaluación y calificación

El sistema de calificación se basa en la siguiente escala numérica:

0 - 4, 9 |

Suspenso |

(SS) |

5,0 - 6,9 |

Aprobado |

(AP) |

7,0 - 8,9 |

Notable |

(NT) |

9,0 - 10 |

Sobresaliente |

(SB) |

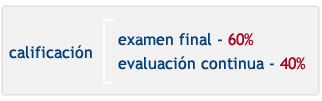

La calificación se compone de dos partes principales:

El examen se realiza al final del cuatrimestre y es de carácter PRESENCIAL y OBLIGATORIO. Supone el 60% de la calificación final y para que la nota obtenida en este examen se sume a la nota final, es obligatorio APROBARLO.

La evaluación continua supone el 40% de la calificación final. Este 40% de la nota final se compone de las calificaciones obtenidas en las diferentes actividades formativas llevadas a cabo durante el cuatrimestre.

Ten en cuenta que la suma de las puntuaciones de las actividades de la evaluación continua permite que realices las que prefieras hasta conseguir el máximo puntuable mencionado en la programación semanal. En ella se detalla la calificación máxima de cada actividad o evento concreto puntuables.

El sistema de evaluación de la asignatura es el siguiente:

SISTEMA DE EVALUACIÓN |

PONDERACIÓN |

PONDERACIÓN |

Participación en foros y otros medios participativos |

0% |

10% |

Realización de trabajos, proyectos y casos |

20% |

30% |

Test autoevaluación |

0% |

10% |

Examen final presencial |

60% |

60% |

Si quieres presentarte sólo al examen final, tendrás que obtener una calificación de 5 puntos sobre 6 para aprobar la asignatura.

Profesorado

Luis Miguel Rivera Cumbicus

Formación: Doctorando en Tecnologías de la Información y Comunicación. Máster en Ingeniería de Software. Máster en Informática Interactiva y Multimedia. Ingeniero Industrial.

Experiencia: Docente a Tiempo Parcial en la Universidad ESAN (Perú), Mas de 25 años implementando Soluciones de Tecnología de la Información en empresas de España y Perú. Seis años de experiencia en el Sector Público Peruano como Analista de Sistemas Especializado.

Líneas de investigación: Inteligencia Artificial (Machine Learning, Deep Leraning, NLP). Aplicaciones prácticas de la Inteligencia Artificial con los lenguajes R y Python. Automatización y Optimización de Proyectos de Transformación Digital.

Pablo Villacorta Iglesias

Formación: Doctor en Ciencias de la Computación e IA, Ingeniero en Informática y Licenciado en CC y Técnicas Estadísticas (segundo premio nacional) por la Universidad de Granada. Científico de datos en la empresa privada, certificado en la tecnología distribuid

Experiencia: Ha sido docente de Grado en la Univ. de Granada, donde ha impartido Ingeniería del Conocimiento e Introducción a la programación. Asimismo, ha sido profesor en el Data Science Bootcamp de IE Business School (2017) en Madrid, impartiendo Ciencia de datos con R y Python. Desde 2015 trabaja como Científico de grandes datos en Stratio Big Data Inc utilizando Apache Spark. Está acreditado por ANECA como Prof. Ayudante Doctor, Prof. de Univ. Privada y Prof. Contratado Doctor.

Líneas de investigación: Ha formado parte del Grupo de Modelos de Decisión y Optimización en el Dpto de Ciencias de la Computación e IA de la Univ. de Granada. Ha publicado más de 25 artículos en revistas internacionales y congresos, en temas de razonamiento con adversarios, soft computing, prospectiva tecnológica y software estadístico. Es autor o co-autor de 6 paquetes de R disponibles en CRAN.

Orientaciones para el estudio

Obviamente, al tratarse de formación online puedes organizar tu tiempo de estudio como desees, siempre y cuando vayas cumpliendo las fechas de entrega de actividades, trabajos y exámenes. Nosotros, para ayudarte, te proponemos los siguientes pasos:

- Desde el Campus virtual podrás acceder al aula virtual de cada asignatura en la que estés matriculado y, además, al aula virtual del Máster. Aquí podrás consultar la documentación disponible sobre cómo se utilizan las herramientas del aula virtual y sobre cómo se organiza una asignatura en la UNIR y también podrás organizar tu plan de trabajo personal con tu profesor-tutor.

- Observa la programación semanal. Allí te indicamos qué parte del temario debes trabajar cada semana.

- Ya sabes qué trabajo tienes que hacer durante la semana. Accede ahora a la sección Temas del aula virtual. Allí encontrarás el material teórico y práctico del tema correspondiente a esa semana.

- Comienza con la lectura de las Ideas clave del tema. Este resumen te ayudará a hacerte una idea del contenido más importante del tema y de cuáles son los aspectos fundamentales en los que te tendrás que fijar al estudiar el material básico. Lee siempre el primer apartado, ¿Cómo estudiar este tema?, porque allí te especificamos qué material tienes que estudiar. Consulta, además, las secciones del tema que contienen material complementario (Lo + recomendado y + Información).

- Dedica tiempo al trabajo práctico (sección Actividades y Test). En la programación semanal te detallamos cuáles son las actividades correspondientes a cada semana y qué calificación máxima puedes obtener con cada una de ellas.

- Te recomendamos que participes en los eventos del curso (sesiones presenciales virtuales, foros de debate…). Para conocer la fecha concreta de celebración de los eventos debes consultar las herramientas de comunicación del aula vitual. Tu profesor y tu profesor-tutor te informarán de las novedades de la asignatura.

Recuerda que en el aula virtual del Curso de introducción al campus virtual puedes consultar el funcionamiento de las distintas herramientas del aula virtual: Correo, Foro, Sesiones presenciales virtuales, Envío de actividades, etc.

|

Ten en cuenta estos consejos…

|